Wie KI Webflow-Seiten im Vergleich zu herkömmlichen CMS-Plattformen interpretiert

TL; DR

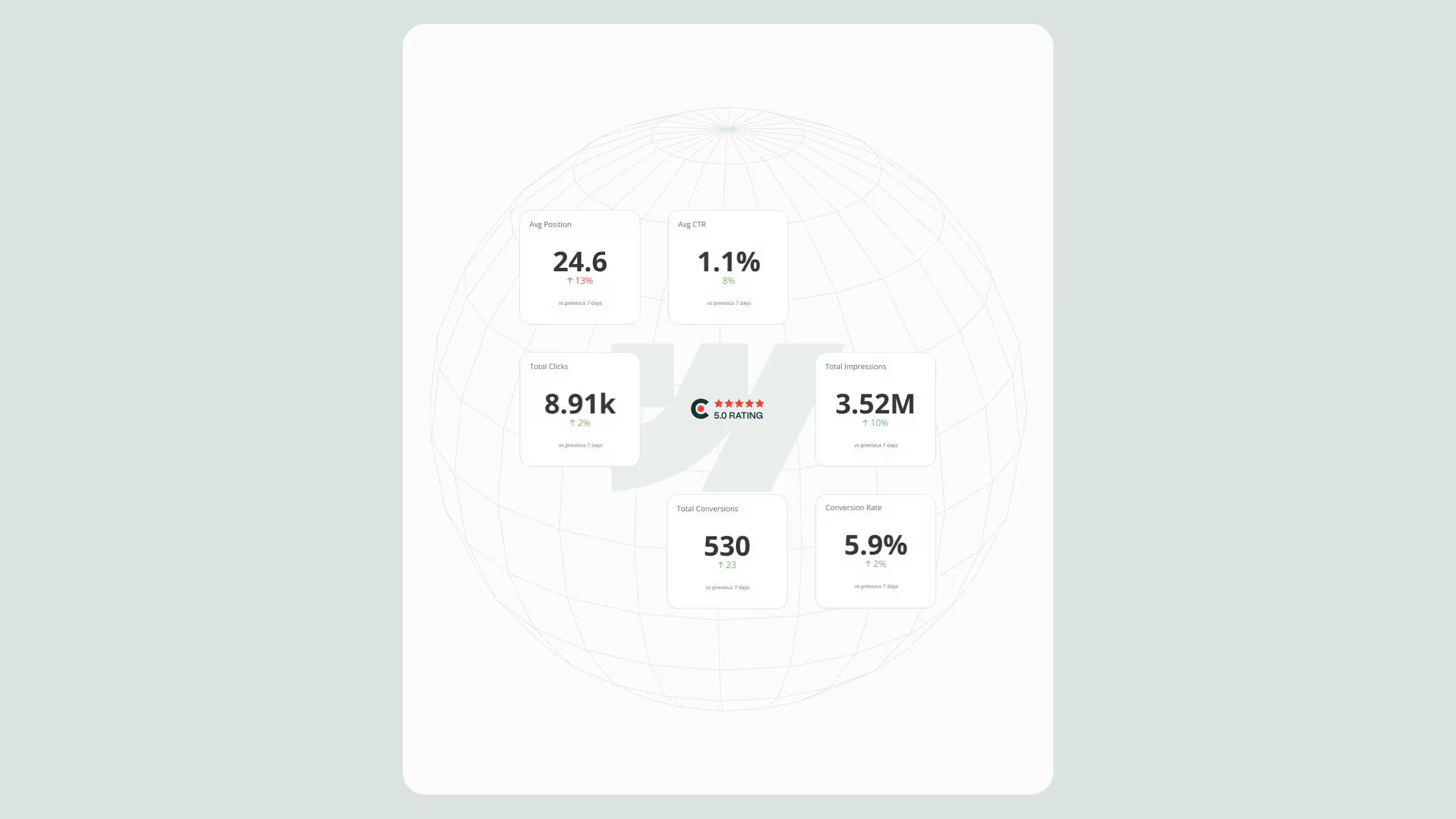

Warum die Frage, wie KI Websites interpretiert, für Vermarkter jetzt wichtig ist

Die Suche hat sich grundlegend geändert. Wenn jemand eine Frage in Perplexity, Googles KI-Übersichten oder ChatGPT mit Webzugriff eingibt, wird die Antwort, die er erhält, nicht aus einer Liste mit blauen Links abgerufen, sondern aus strukturiertem Inhalt synthetisiert, den KI-Modelle sauber lesen, analysieren und zitieren können. Bei dieser Unterscheidung zwischen lesbar und unlesbar geht es nicht um Schlüsselwörter. Es geht um Architektur.

Verstehen wie KI Websites interpretiert hat sich von einer technischen Nischenkuriosität zu einem strategischen Marketingunternehmen entwickelt. CMOs und Marketingleiter, die derzeit Plattformentscheidungen evaluieren, ob sie bei WordPress bleiben, zu Webflow wechseln oder einen fragmentierten Tech-Stack konsolidieren sollen, erkennen, dass die Plattform selbst jetzt ein Signal ist. Das ausgegebene HTML, die Hierarchie, die es beibehält, und der Lärm, den es verursacht, beeinflussen, ob ein Sprachmodell die Bedeutung Ihres Inhalts extrahieren oder ihn ganz überspringen kann.

Dieser Artikel behandelt keine Optimierungschecklisten. Es behandelt die Interpretationsmechanik, was im Parser passiert, wenn ein Sprachmodell auf Ihre Seite trifft, und warum die Plattform, die diese Seite generiert, wichtiger ist, als die meisten Marketingteams derzeit annehmen.

Wie LLMs HTML tatsächlich analysieren: Die Mechanik hinter dem Vorhang

Große Sprachmodelle lesen Websites nicht so wie Menschen. Wenn eine LLM-Engine eine Seite crawlt, verarbeitet sie die serialisierte Textdarstellung des HTML-Dokuments und extrahiert Inhalte auf der Grundlage des Elementtyps, der Position im DOM-Baum und der semantischen Beziehungen zwischen Elementen. Seiten mit sauberem, hierarchischem HTML ermöglichen es Modellen, Überschriften, Textinhalte, Listen und Definitionen mit hoher Präzision zu identifizieren. Seiten mit übermäßigem Markup, verschachtelten div-Strukturen und Skriptinjektionen erzeugen mehrdeutige Textströme, die die Zuverlässigkeit bei der Extraktion verringern.

Um zu verstehen, warum die Plattformarchitektur wichtig ist, hilft es zu verstehen, was tatsächlich passiert, wenn ein KI-System Ihre Seite liest.

Die meisten LLM-basierten Antwortmaschinen, unabhängig davon, ob sie in Suchprodukte integriert sind oder als eigenständige Recherchetools arbeiten, empfangen kein rohes HTML und verarbeiten es visuell. Sie arbeiten mit einer analysierten, linearisierten Version Ihrer Inhalte. Die Parsing-Pipeline folgt in der Regel diesen Schritten:

- HTML wird abgerufen durch einen Crawler oder Headless-Browser-Agenten

- Das DOM ist gebaut der Browser oder Parser erstellt aus dem Markup einen hierarchischen Baum

- Inhalt wird extrahiert basierend auf der Rolle und Position des Elements in diesem Baum

- Text ist linearisiert Die verschachtelte Baumstruktur wird zu einer Abfolge von Text-Tokens zusammengefasst

- Diese Token-Sequenz wird übergeben in das Kontextfenster des Modells zur Zusammenfassung, Zitierung oder Antwortgenerierung

Jeder Schritt in dieser Pipeline wird von der Qualität des von der Plattform generierten HTML-Codes beeinflusst. Ein sauberer, logischer DOM-Baum erzeugt eine saubere, logisch geordnete Token-Sequenz. Ein fragmentiertes, mit Plug-ins überfülltes DOM erzeugt ein lautes DOM.

Die entscheidende Erkenntnis dabei ist, dass Parser Entscheidungen auf der Grundlage von Signalen und nicht auf der Grundlage von Absichten treffen. Sie wissen nicht, dass Ihr Plugin drei zusätzliche Wrapper-Divs um einen Absatz herum hinzugefügt hat. Sie sehen nur diese Divs und müssen entscheiden, ob es sich bei dem darin enthaltenen Text um eine Überschrift, einen Hauptteil, eine Navigation oder etwas Dekoratives handelt. Je mehrdeutiger die Signale sind, desto geringer ist die Qualität dessen, was extrahiert wird.

HTML-Hierarchie und die Signale, die KI-Engines priorisieren

Das wichtigste strukturelle Signal, das ein KI-Parser verwendet, ist die Überschriftenhierarchie. Ein H1 kommuniziert das Hauptthema der Seite. H2s bilden die Hauptabschnitte. H3s verfeinern und unterteilen. Wenn diese Hierarchie intakt und logisch ist, kann ein Sprachmodell eine genaue Gliederung Ihrer Inhalte erstellen, noch bevor es den Haupttext liest.

Dies ist für AEO (Answer Engine Optimization) von großer Bedeutung. Wenn Perplexity oder die KI-Übersichten von Google eine Quelle zitieren, zitieren sie häufig Inhalte, die direkt unter einem eindeutigen H2- oder H3-Label standen, das der Anfrage des Nutzers entsprach. Die Überschrift diente als Indexeintrag. Der Absatz darunter diente als Antwort.

Neben Überschriften gewichten KI-Parser mehrere zusätzliche strukturelle Signale:

- Semantische HTML-Elemente:

<article>,<section>,<main>,<nav>,<aside>,<header>, und<footer>geben Sie explizite Rollensignale. Ein Parser trifft auf einen<main>Tag weiß, dass der Hauptinhalt folgt. Ein Parser trifft auf einen<aside>weiß, dass der Inhalt ergänzend ist. - Strukturen auflisten:

<ul>,<ol>, und<li>Tags signalisieren aufzählbare Informationen: Fakten, Schritte oder Vergleiche, die Modelle trainiert haben, um sie als strukturierte Daten zu extrahieren. - Definitions- und Beschreibungsmuster: Absätze, die einer Überschrift mit dem Muster „X ist Y, weil Z“ folgen, sind hochwertige Extraktionsziele für KI-Antwort-Engines.

- Schema.org-Markup: Strukturierte Daten eingebettet in

<script type="application/ld+json">Tags bieten maschinenlesbare Metadaten, die Google-Suchsysteme verwenden können, um Seiteninhalte besser zu verstehen und zu klassifizieren. Laut Googles strukturierte Datendokumentation, ein korrekt implementiertes Schema hilft Suchmaschinen dabei, zu interpretieren, worum es auf einer Seite geht und wie ihr Inhalt strukturiert ist, unabhängig davon, wie er den Nutzern präsentiert wird.

Was KI-Engines depriorisieren, ist ebenso aufschlussreich: Inline Stil Attribute, die durch den Körperinhalt verstreut sind, <div> Elemente ohne semantische Rolle, durch JavaScript gerenderte Inhalte, die während der Crawlzeit nicht ausgeführt wurden, und doppelte Überschriftenmuster, die die Hierarchie durchbrechen.

Die HTML-Ausgabe von Webflow: Was der Parser sieht

Webflow generiert HTML auf Codeebene, ohne dass eine Plugin-Ebene zwischen Ihren Designentscheidungen und der endgültigen Ausgabe liegt. Wenn Sie im Designer von Webflow eine Überschrift erstellen, erfolgt die Ausgabe direkt <h2> Element im DOM. Wenn Sie einen Abschnitt erstellen, können Sie ihm ein semantisches Tag zuweisen <section>, <article>, <main> direkt im Elementeinstellungsfeld.

Diese architektonische Direktheit führt zu zwei Ergebnissen, die für die KI-Interpretation von Bedeutung sind:

Erstens ist der DOM-Baum flach und logisch. Webflow-Seiten enthalten in der Regel weniger unnötige Wrapper-Elemente als WordPress-Seiten, die mit Page Buildern erstellt wurden. Die durchschnittliche Webflow-Seite verwendet ein strukturiertes klassenbasiertes Styling, ohne zusätzliches Markup einzufügen, um die Plugin-Funktionalität zu unterstützen. Das Ergebnis ist ein leichteres DOM, das Parser schnell und mit höherer Sicherheit durchqueren können.

Zweitens werden Überschriftenhierarchien durch den Arbeitsablauf des Designers strukturell durchgesetzt. Da der Designer von Webflow den Elementtyp in der Benutzeroberfläche explizit macht, ist es weniger wahrscheinlich, dass Designer und Inhaltseditoren versehentlich ein H1 für Stylingzwecke verwenden oder Überschriftenebenen überspringen, weil eine visuelle Hierarchie richtig aussah. Die visuelle Ausgabe wird der semantischen Ausgabe direkter zugeordnet.

Für Teambuilding mit Die Entwicklungskapazitäten von Webflow, das bedeutet auch, dass die CMS-gesteuerten Seiten (Blogbeiträge, Fallstudien, Ressourcenseiten) dieselbe saubere Struktur wie die statischen Seiten erben, da die CMS-Vorlage mit derselben Steuerung auf Elementebene erstellt wurde.

Aus Sicht der LLM-Interpretation sieht das, was Webflow an einen Parser sendet, in vereinfachter Form normalerweise so aus:

<main>

<article>

<h1>Primary Topic</h1>

<p>Introductory paragraph establishing context.</p>

<section>

<h2>Major Subtopic</h2>

<p>Explanatory body content.</p>

<ul>

<li>Enumerable point one</li>

<li>Enumerable point two</li>

</ul>

</section>

</article>

</main>Der Parser liest dies als ein klar definiertes Dokument: ein Hauptthema, ein Artikelcontainer, klar beschriftete Abschnitte. Die Extraktion ist einfach.

Plugin-lastige CMS-Plattformen: Was WordPress tatsächlich an ein LLM sendet

WordPress als Plattform produziert nicht von Natur aus schlechtes HTML. Eine sorgfältig gepflegte WordPress-Website mit minimalen Plug-ins kann eine saubere, semantische Ausgabe generieren. Das Problem ist, wie die meisten WordPress-Seiten in der Praxis tatsächlich erstellt und verwaltet werden.

Auf der typischen Unternehmens- oder SaaS-WordPress-Website werden zwischen 20 und 50 aktive Plugins ausgeführt. Jedes Plugin kann dazu beitragen:

- Zusätzlich

<div>Wrapper rund um Inhaltselemente - Inline

<script>Tags, die Tracking, Formulare oder Widgets in den Text einfügen - Inline

<style>Deklarationen, die CSS überschreiben oder duplizieren - Redundante Überschriftenelemente wurden zur visuellen Formatierung und nicht zur semantischen Bedeutung hinzugefügt

- Drittanbieter-JavaScript, das das DOM nach dem ersten Laden ändert

Was ein LLM-Parser findet, wenn er diese Art von Seite liest, ist keine saubere Dokumentstruktur, sondern mehrere überlappende Dokumentstrukturen aus mehreren Quellen, die zu einem einzigen Textstrom zusammengefasst sind. Der Parser muss probabilistische Entscheidungen darüber treffen, welche Textelemente zum Inhalt und welche zum Plugin-Gerüst gehören.

Dieses Problem wird durch die häufige Verwendung von visuellen Seitenerstellern wie Elementor, Divi oder WPBakery noch verschärft. Diese Tools generieren tief verschachtelte <div> Strukturen zur Unterstützung von Drag-and-Drop-Layoutsystemen. Ein einzelner Absatz auf einer von Elementor erstellten Seite kann in fünf oder sechs verschachtelte Container-Divs eingeschlossen werden, bevor der Textknoten erscheint. Für einen Menschen, der die Seite liest, ist dies unsichtbar. Für einen Parser, der das DOM in Tokens linearisiert, führt dies zu einer erheblichen strukturellen Mehrdeutigkeit.

Für Teams, die eine erwägen Migration von WordPress nach Webflow, allein der Unterschied in der HTML-Sauberkeit stellt eine bedeutende Veränderung in der Art und Weise dar, wie KI-Systeme den Inhalt lesen und interpretieren, bevor weitere Optimierungsarbeiten durchgeführt werden.

Direkter Vergleich: Webflow und herkömmliches CMS für KI-Lesbarkeit

Die in dieser Tabelle angegebene Lücke ist nicht theoretisch. Sie spiegelt den strukturellen Unterschied zwischen einer Plattform wider, die auf der HTML-Ausgabequalität ausgelegt ist, und einer Plattform, die sich durch ein Ökosystem von Erweiterungen von Drittanbietern entwickelt hat. Für KI-Engines, die Hunderttausende von Dokumenten analysieren, um Antwortdatenbanken zu erstellen, dienen diese Signale als Qualitätsfilter.

Semantische Struktur, Entitätserkennung und AEO-Zitate

KI-gestützte Antwort-Engines wie Google AI Overviews und Perplexity wählen Zitierquellen teilweise danach aus, wie eindeutig eine Seite ihre Entitäten, Personen, Organisationen, Themen und Konzepte identifiziert. Seiten mit einer klar definierten semantischen Struktur ermöglichen es Sprachmodellen, Überschriften und Hauptabschnitte bekannten Entitäten mit größerer Genauigkeit zuzuordnen. Eine Seite, die strukturierte Überschriften, Schema-Markup und eine konsistente Entitätsbenennung verwendet, wird mit größerer Wahrscheinlichkeit als direkte Antwortquelle zitiert als eine Seite mit gleichwertigem schriftlichen Inhalt, aber mehrdeutiger HTML-Struktur.

Mithilfe der Entitätserkennung bestimmen KI-Systeme, worum es auf einer Seite im Wesentlichen geht. Dies unterscheidet sich vom Keyword-Matching. Wenn ein LLM eine Seite liest, versucht er, die Konzepte der realen Welt, die besprochen werden, zu identifizieren, nicht nur die Wörter, mit denen sie besprochen wurden. Je klarer die strukturellen Signale sind, die einen Inhalt umgeben, desto sicherer kann das Modell diesen Inhalt einer bekannten Entität zuordnen.

Schema.org bietet ein gemeinsames Vokabular für strukturierte Daten, das es Websites ermöglicht, Entitäten und ihre Beziehungen in einem maschinenlesbaren Format zu beschreiben. Strukturierte Daten, die als JSON-LD in einer Seite implementiert sind <head> oder <body> hilft Suchsystemen dabei, besser zu verstehen, worum es in den Inhalten geht, einschließlich wichtiger Attribute wie Inhaltstyp, Autor und Thema. Wenn strukturierte Daten konsistent und präzise implementiert werden, können sie die Art und Weise verbessern, wie Maschinen Seiteninhalte interpretieren, obwohl sie kein vollständiges oder eindeutiges Verständnis garantieren.

CMS-Setups mit vielen Plugins führen häufig zu Schemakonflikten. Ein SEO-Plugin generiert einen Satz von JSON-LD. Ein Review-Plugin generiert ein anderes. Ein Breadcrumb-Plugin fügt ein drittes hinzu. Ein Sprachmodell, das diese konkurrierenden strukturierten Datenblöcke analysiert, empfängt widersprüchliche Entitätssignale und muss die Mehrdeutigkeit probabilistisch auflösen. In einigen Fällen werden strukturierte Daten möglicherweise vollständig verworfen und nur auf Inhaltssignale zurückgegriffen.

Für Teams, die sich auf AEO- und LLM-Transparenz konzentrieren, ist die Fähigkeit der Plattform, widersprüchliche, sauber strukturierte Daten zu erzeugen, kein untergeordnetes technisches Detail, sondern eine grundlegende Voraussetzung für ein konsistentes KI-Zitat.

Die unterstützende semantische Schlüsselwortebene ist auch hier wichtig. Die konsequente Verwendung von Begriffen wie „Antwortmaschinenoptimierung“, „Sichtbarkeit in der KI-Suche“ und „strukturierter Inhalt für KI“ innerhalb einer klar definierten Überschriftenhierarchie ermöglicht es Sprachmodellen, Ihre Inhalte mit den Konzepten zu verknüpfen, nach denen Nutzer fragen, ohne dass Keyword-Stuffing erforderlich ist. Die Struktur erledigt die kontextuelle Arbeit.

Das Rendering-Problem: JavaScript-lastige Seiten und LLM-blinde Flecken

Viele KI-Crawler und LLM-basierte Suchmaschinen verarbeiten einen ersten HTML-Snapshot einer Seite, bevor JavaScript ausgeführt wird. Das bedeutet, dass Inhalte, die clientseitig über React, Vue oder jQuery gerendert werden, einschließlich dynamisch geladener Artikel, Testimonials oder FAQ-Abschnitte, für das Model möglicherweise völlig unsichtbar sind. Plattformen, die bei der Bereitstellung von Inhalten stark auf JavaScript angewiesen sind, erzeugen KI-blinde Flecken in Abschnitten, die für menschliche Besucher sichtbar sind, aber im analysierten Dokument fehlen. Seiten, die wichtige Inhalte im ursprünglichen, vom Server gerenderten HTML-Code bereitstellen, sind für KI-Extraktionssysteme deutlich leichter zugänglich.

Webflow-Seiten rendern ihren Hauptinhalt serverseitig. Das HTML, das ein LLM-Crawler empfängt, enthält die Überschriftenstruktur, die Hauptabsätze, die Listen und die strukturierten Daten, vollständig formatiert, ohne dass eine JavaScript-Ausführung erforderlich ist, um materialisiert zu werden.

WordPress-Websites, die JavaScript-abhängige Plugins für Inhalte, Popup-Inhaltsbereiche, bedingt geladene FAQ-Blöcke oder Ajax-gesteuerte Testimonial-Karussells verwenden, können einem JavaScript-deaktivierten Crawler ein deutlich anderes Dokument bereitstellen als einer typischen Browsersitzung. KI-Crawler sind nicht immer so konfiguriert, dass sie JavaScript ausführen, und selbst wenn dies der Fall ist, variieren die Ausführungszeit und die Rendertreue.

Dies hat direkte Auswirkungen auf AEO. Wenn Ihr FAQ-Bereich über JavaScript gerendert wird, wird er von einer KI-Antwortmaschine möglicherweise nie gesehen und daher auch nie zitiert. Wenn deine oben genannten Testimonials durch ein Plugin nach dem Laden eingespeist werden, ist der soziale Beweis, der deine Glaubwürdigkeit für einen menschlichen Leser definiert, für das Model, das ein Bild deiner Seite erstellt, unsichtbar.

Die praktische Implikation für Marketingteams lautet: Der Inhalt, der für das KI-Zitieren am wichtigsten ist (Definitionen, Antworten, strukturierte Vergleiche), muss im vom Server gerenderten HTML-Code existieren. Das ist sowohl eine Plattformbeschränkung als auch eine inhaltliche Entscheidung.

Erfahren Sie mehr zu diesem Thema in der Ressourcen und Blog von Broworks, wo wir LLM-Inhaltsstrukturen, AEO-Frameworks und Plattformüberlegungen für die Sichtbarkeit von KI-Suchen behandeln.

Mehr Geschichten

.svg)

.svg)